Futur de l’IT : qui pourra arrêter l’intelligence artificielle ?

Rien ne semble pouvoir entraver le développement de l’intelligence artificielle. Les cas d’usage se multiplient dans notre quotidien et les chercheurs créent des modèles de plus en plus gros. Pour autant, seront-ils vraiment » intelligents » un jour ?

L ’essor de l’IA est incontestablement le phénomène majeur de la décennie 2010-2020. En s’appuyant sur des concepts nés dans les années 1950 (!), les chercheurs et, aujourd’hui, les entreprises multiplient les cas d’usage.

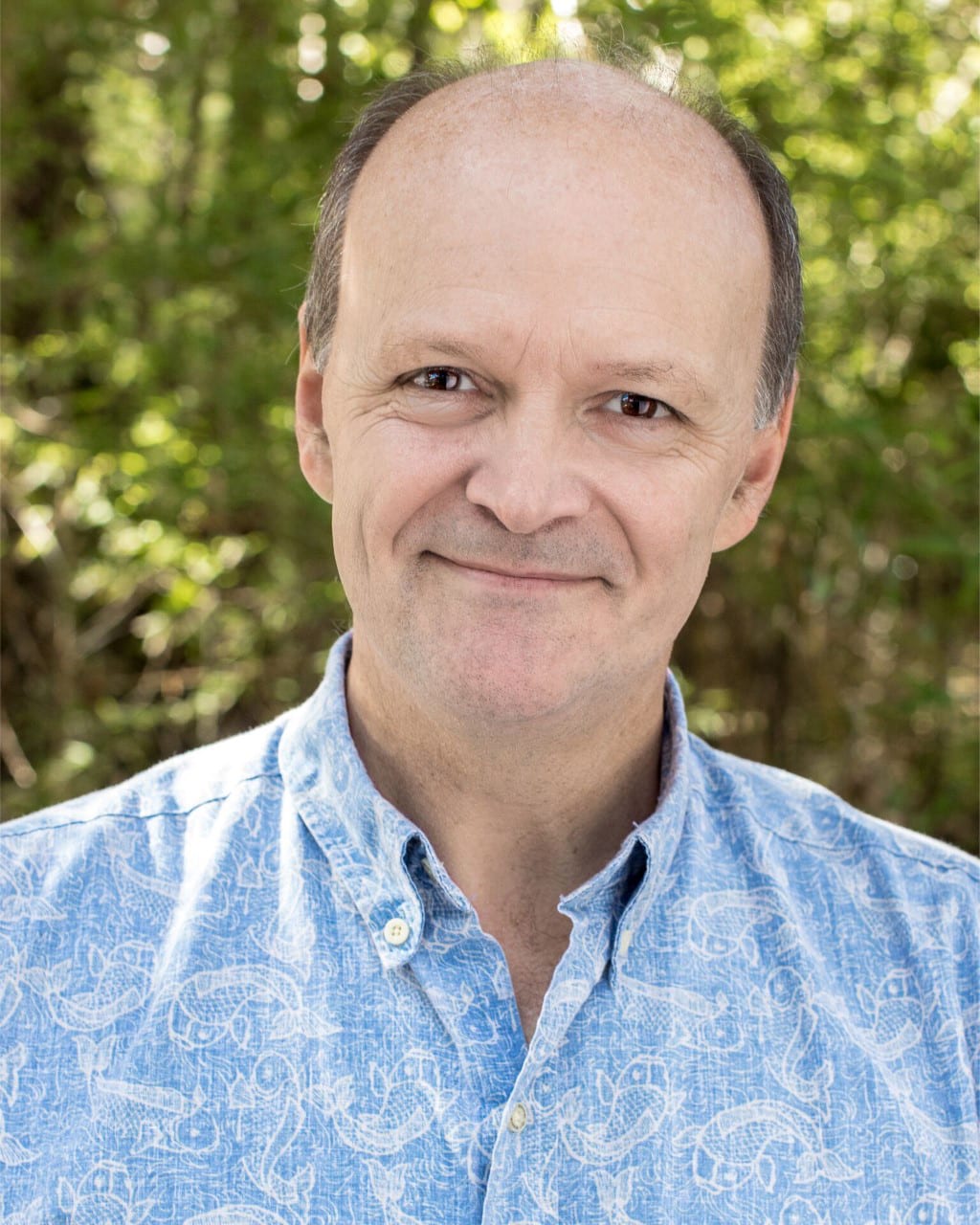

En 2040, celle-ci sera ubiquiste, omniprésente dans notre quotidien : « Dans les prochaines années, les algorithmes apprenants vont s’appliquer à de nombreux domaines différents », explique Luc Julia, l’actuel Chief Technology Officer et Senior Vice-President du Samsung Strategy & Innovation Center (SSIC).

« Toutes les données qui n’étaient pas conservées dans l’industrie vont permettre de faire comprendre aux machines de nouveaux domaines et prédire les évolutions. C’est ainsi que le prédictif va se diffuser dans le milieu industriel et dans le secteur de la santé. On va exploiter de nouvelles données. L’ADN, par exemple, est un champ statistique extraordinaire et pourra sans doute être mieux exploité à l’avenir. De même dans le transport, la voiture autonome de niveau 5 n’existera jamais, mais le niveau 4 permettra déjà d’abaisser énormément le nombre d’accidents de la route », ajoute-t-il.

Des algorithmes encore en évolution rapide

Paradoxalement, ce succès de l’IA dans les entreprises se fonde sur des algorithmes bien connus. Les réseaux de neurones ont été imaginés dès 1956 et, après une longue traversée du désert, l’intelligence artificielle est désormais fortement installée dans les entreprises. En dépit de l’effet de « hype » actuel, les résultats obtenus restent très impressionnants, estime Marc Duranton, chercheur au CEA List.

« Le véritable boum de l’IA a eu lieu en 2012, avec Supervision, le réseau qui a permis de diminuer de manière significative le taux d’erreur dans la reconnaissance des images du benchmark ImagiNet. Celui-ci est passé de 25 % d’erreur à 15 % et, quelques années plus tard, nous en sommes à moins de 1 % d’erreur contre 5 % pour l’humain. En cela, les réseaux de neurones atteignent déjà des résultats suprahumains. » ajoute-t-il.

Cet apprentissage supervisé, c’est-à-dire avec des données annotées par les humains, présente des limites, car il est impossible d’annoter manuellement toutes les données. D’autres types d’apprentissages montent actuellement en puissance. Ainsi, le Reinforcement Learning, pour lequel on donne une fonction de coût : la machine itère d’elle-même et génère des cas à l’infini pour faire mieux. C’est cette approche qui a permis à Google DeepMind de développer AlphaGo Zero… et de renvoyer l’humain à sa triste condition.

Autre approche qui monte en puissance, les « Transformers », dont l’exemple le plus médiatique est actuellement GPT-3, le modèle créé par OpenAI. « Avec 175 milliards de paramètres, c’est un très grand réseau qui est capable de délivrer des résultats assez intéressants », explique le chercheur qui modère toutefois l’enthousiasme que semble causer cette IA ayant réponse à tout : « GPT-3 peut délivrer d’excellentes réponses à des questions simples, mais aussi donner des réponses totalement idiotes à des questions absurdes. Les réseaux Transformers restent très efficaces pour compléter des propositions, prédire le futur grâce à un apprentissage autosupervisé. »

Vers une IA consciente en 2040 ?

Très adapté au NLP (Natural Language Processing), le Self-Supervised Learning permet à la machine de prédire ce qui manque dans une séquence temporelle. Sur ce modèle, on a réalisé l’apprentissage de GPT-3 sur Wikipedia, sur un corpus de livres, etc. Et il est maintenant capable de compléter une proposition. Seulement, cette IA n’a aucune compréhension du monde, à l’image cette nouvelle d’Isaac Asimov où l’on pose la question suivante à la machine : « Si une poule et demie pond un œuf et demi en un jour et demi, combien neuf poules pondront-elles d’œufs en neuf jours ? » Celle-ci répond sans ciller : « 54 »…

L’IA reste totalement incapable de détecter l’absurdité de la question ; or, une IA pourra-t-elle avoir, un jour, une réelle compréhension du monde, donc une forme de conscience ? Les chercheurs restent très partagés sur la question.

Dans son livre, « Architects of Intelligence: The truth about AI from the people building it », Martin Ford a interrogé 23 experts internationaux de l’intelligence artificielle sur cette question.

Pour 16 d’entre-deux, une telle IA ne devrait apparaître qu’à l’horizon 2099.

Seul le célèbre futurologue Raymond Kurzweil, actuel directeur de l’engineering chez Google, estime qu’une telle IA pourra exister en 2029…

D’ici là, de nouvelles technologies pourraient bien rebattre les cartes de l’intelligence artificielle. C’est le cas des composants neuromorphiques, des puces spécifiquement conçues pour porter et accélérer les réseaux de neurones, mais aussi de l’informatique quantique.

« Cette nouvelle approche de l’informatique s’apparente, d’une certaine façon, à notre cerveau et aux intelligences artificielles. Peut-être, l’intelligence artificielle sera-t-elle en mesure d’exister à partir de cette approche quantique, mais, pour l’instant, on n’en sait rien et cela sera très compliqué à mettre en œuvre. Une autre technologie que l’on ne maîtrise absolument pas aujourd’hui, c’est la biologie. Recréer quelque chose qui ressemblera à notre cerveau, c’est un peu le rêve de Frankenstein et les problèmes éthiques seront bien plus importants que ceux que l’IA informatique nous pose aujourd’hui. On ne comprend que 20 à 40 % de notre cerveau et ce sera difficile de l’imiter. Mais c’est une piste qui se concrétisera peut-être dans… mille ans », conclut Luc Julia.

par Alain Clapaud