Yann LeCun - Meta AI : « Le futur de l’IA n’est pas dans les LLM, mais dans l’IA guidée par les objectifs »

A l’avenir, toutes les interactions des humains avec les machines passeront par des assistants. C’est la position de Yann LeCun, Chief AI Scientist de Meta, qui considère que l’IA devra atteindre le niveau de l’intelligence humaine pour mieux nous servir.

Pour Yann LeCun, Vice-President et Chief AI Scientist chez Meta AI, c’est une certitude : l’IA générative telle qu’elle existe aujourd’hui, avec les LLM, est une impasse technologique.

Aussi gros soient-ils, ceux-ci sont incapables d’accomplir ce que les humains et les animaux font tous les jours.

« Les animaux peuvent apprendre à faire des tâches très rapidement, ils peuvent comprendre comment les choses fonctionnent, ils peuvent raisonner, planifier et, comme les humains, ils ont du bon sens. Leurs comportements sont dirigés par des buts, des objectifs. La question est comment atteindre ce niveau ? » expose-t-il.

Le chercheur a choisi une approche totalement différente : l’Objective-Driven AI.

Il y a un an et demi, il publiait un premier papier de recherche décrivant cette nouvelle manière de concevoir un système d’intelligence artificielle et selon lui, cette approche à beaucoup progressé.

Amener l’IA au niveau des humains

L’ambition de cette architecture n’est rien moins que de faire passer l’IA au niveau supérieur et l’amener au niveau des humains.

« L’objectif est de rendre les machines capables de comprendre le monde, se souvenir, raisonner et planifier. 4 choses que les LLM sont incapables de faire. » résume Yann LeCun.

Certains verront dans ce projet les prémisses d’une IA générale, mais le chercheur préfère le terme d’AMI (Advanced Machine Intelligence).

Selon sa définition, il s’agit de systèmes capables de comprendre le monde à partir de données de capteurs. Ils doivent disposer d’une mémoire persistante, mais surtout être capables de planifier leurs actions afin de remplir un objectif. Enfin, ces systèmes doivent être contrôlables et sûrs par conception et non pas fine-tuning. Ces 4 contraintes devront être remplies par une architecture de type Objective-Driven AI.

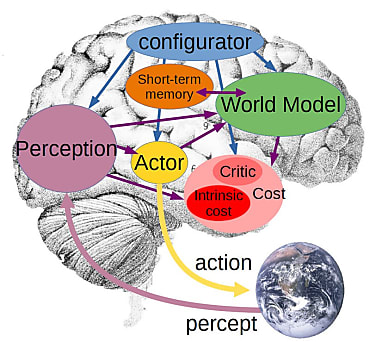

Yann LeCun a imaginé une architecture cognitive qui compte de multiples modules pour assurer la perception, la mémoire court-terme, la mémoire associative, un module d’évaluation du coût d’une stratégie et un module pour agir.

La modélisation du monde est la clé de voûte de cette architecture.

Le chercheur décrit le fonctionnement de ce cerveau artificiel : « L’IA va percevoir le monde, avoir sa propre représentation de l’état du monde et va combiner cette information avec celles dont elle dispose en mémoire. Cela vient alimenter un modèle qui va prédire ce que sera l’état du monde lorsqu’une série d’actions aura été exécutée. »

Tous les humains et les animaux le font de manière totalement inconsciente au quotidien, et pourtant la planification hiérarchique est encore totalement hors de portée des IA.

Comme le joueur d’échec qui imagine ses prochains mouvements et évalue leur pertinence, cette planification va permettre de vérifier que le nouvel état visé répond à une série de contraintes. Et notamment s’assurer que la tâche demandée est effectivement réalisée.

« Cette approche permet de mettre des barrières à cette IA et s’assurer que ces actions ne vont pas dépasser certaines règles. Par exemple, être sûr que cette série d’actions ne va heurter quelqu’un. Par optimisation, le système va essayer de trouver la série d’actions qui va minimiser l’objectif. » Yann Lecun assure que tout est codé « en dur » dans la mécanique du système et ne peut être perturbé par un prompt qui chercherait à faire dérailler le système.

Développer l’AMI…l’Advanced Machine Intelligence

« Le modèle va appliquer une séquence d’actions avec de multiples étapes et les barrières s’appliquent à l’ensemble, mais aussi sur chaque étape intermédiaire. » détaille-t-il. Il compare cette approche à une ancienne technique bien connue des ingénieurs qui calculent les trajectoires de fusées : le Model Predictive Control.

« La nouveauté, c’est la manière dont on va faire tourner le World Model. Traditionnellement, en optimisation, le modèle de monde est intégré. Ici il va devoir être appris à partir des canaux de perception, c’est ce qui est compliqué. » Comme le monde qui nous entoure n’est pas déterministe et pleinement prédictible, il est nécessaire de mettre en place des variables latentes pour paramétriser le jeu des prédictions plausibles.

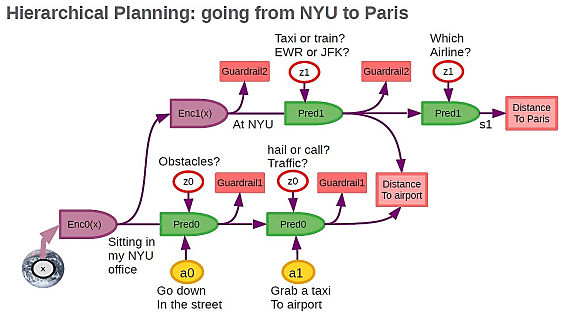

Autre défi de taille pour cette IA : lui permettre de réaliser une planification hiérarchique pour accomplir les tâches qui lui sont soumises. Prenant l’exemple d’un voyage de New-York / Paris, une telle mission implique un nombre de sous-tâches incroyablement élevé, à commencer par se lever de sa chaise, enfiler son manteau, prendre son sac, ouvrir la porte, aller vers l’ascenseur, etc.

« Comment faire une telle planification hiérarchique et comment entraîner un système à le faire ? Tous les animaux et les humains savent le faire, les machines, non. C’est un problème encore totalement irrésolu à ce jour et c’est pourtant un point essentiel. » insiste Yann LeCun.

Pivot de l’architecture AMI : un modèle descriptif du monde

Un autre défi doit encore être relevé, celui d’entraîner le modèle descriptif du monde qui va servir de base de réflexion pour cette AMI. Les bébés humains apprennent les concepts de base dans les premiers mois de la vie, simplement par interactions.

« On peut imaginer entraîner un système à apprendre des séquences vidéo. En masquant une partie de la vidéo, on peut apprendre à un modèle à prédire la suite de la séquence et ainsi lui apprendre des comportements et des actions pour reproduire la scène. Cette approche d’entraînement auto-supervisé que nous connaissons depuis 10 ans ne marche pas. Quand vous demandez au système de prévoir la vidéo, il produit une vidéo floue car devant toutes les possibilités des suites possibles, le modèle produit une moyenne. » explique Yann LeCun.

L’architecture Cognitive de l’IA guidée par les objectifs imaginée par Yann LeCun et ses équipes de chercheurs

Le chercheur a proposé en 2022 une nouvelle approche : le JEPA (Joint Embedding Predictive Architecture).

« Il ne s’agit pas d’une architecture générative, car au lieu de prévoir la suite de la vidéo avec tous ses détails, on prend la vidéo et on la fait passer dans un encodeur qui génère une représentation abstraite du contenu de la vidéo. La prédiction a lieu non pas au niveau des pixels de la vidéo, mais de la représentation de la scène. » détaille-t-il.

A la différence des modèles génératifs qui prédisent les scènes avec de nombreux détails mais en ajoutant des détails aberrants, l’approche JEPA travaille au niveau de la représentation abstraite de la scène.

Cette nouvelle approche nécessite encore du travail de recherche. « Il y a encore 4 ans nous n’avions pas de réponse à la façon dont on pouvait entraîner les JEPA. Aujourd’hui, nous avons la réponse, par contre il faut veiller à éviter l’effondrement du modèle. C’est un phénomène où le modèle commence à ignorer les entrées et produit une sortie constante facile à prévoir. »précise-Yann Lecun,.

Selon lui, les modèles JEPA peuvent opérer sur des flux Vidéo et constituent en cela un sérieux prétendant pour l’entraînement d’un modèle du monde à partir de vidéos pour une IA guidée par les objectifs.

Le chercheur a conclu son intervention par une nouvelle charge contre les LLM : « Nous avons besoin de puissance de calcul. C’est nécessaire, mais pas suffisant. On ne va pas gérer une IA au niveau de l’humain simplement en entraînant des LLM existants sur plus de données et avec plus de puissance. Leurs performances saturent déjà en les entraînant sur la totalité des textes accessibles sur le Web. »

Toute la recherche n’est pas encore là pour donner naissance à des IA guidées par les objectifs. Quant à une IA au niveau de l’humain, Yann Lecun n’y croit pas avant les 3 à 5 ans estimant qu’il faudra encore des décennies pour y parvenir. Néanmoins, il a la certitude qu’elle adviendra.

Propos recueillis lors de la conférence WAICF de Cannes, en Février 2024

Photos : © DR Meta

Sur le même thème

Voir tous les articles Data & IA